Теоретической основой информатики является группа фундаментальных наук таких как: теория информации, теория алгоритмов, математическая логика, теория формальных языков и грамматик, комбинаторный анализ и т.д. Кроме них информатика включает такие разделы, как архитектура ЭВМ, операционные системы, теория баз данных, технология программирования и многие другие. Важным в определении информатики как науки является то, что с одной стороны, она занимается изучением устройств и принципов действия средств вычислительной техники, а с другой – систематизацией приемов и методов работы с программами, управляющими этой техникой.

Информационная технология – это совокупность конкретных технических и программных средств, с помощью которых выполняются разнообразные операции по обработке информации во всех сферах нашей жизни и деятельности. Иногда информационную технологию называют компьютерной технологией или прикладной информатикой.

Информация аналоговая и цифровая. Термин «информация» восходит к латинскому informatio – разъяснение, изложение, осведомленность.

Информацию можно классифицировать разными способами, и разные науки это делают по-разному. Например, в философии различают информацию объективную и субъективную. Объективная информация отражает явления природы и человеческого общества. Субъективная информация создается людьми и отражает их взгляд на объективные явления.

В информатике отдельно рассматривается аналоговая информация и цифровая. Это важно, поскольку человек благодаря своим органам чувств, привык иметь дело с аналоговой информацией, а вычислительная техника, наоборот, в основном, работает с цифровой информацией.

1. Представление информации в ЭВМ

1.1 Непрерывная и дискретная информация

Человек воспринимает информацию с помощью органов чувств. Свет, звук, тепло – это энергетические сигналы, а вкус и запах – это результат воздействия химических соединений, в основе которого тоже энергетическая природа. Человек испытывает энергетические воздействия непрерывно и может никогда не встретиться с одной и той же их комбинацией дважды. Нет двух одинаковых зеленых листьев на одном дереве и двух абсолютно одинаковых звуков – это информация аналоговая. Если же разным цветам дать номера, а разным звукам – ноты, то аналоговую информацию можно превратить в цифровую.

Классификация накопителей источников информации

Распределение сигналов на дискретные и непрерывные, как было отмечено выше, зависит от параметров, которые могут принимать конечное либо бесконечное множество значений. Это же разделение применимо и к источникам информации, которые могут быть классифицированы как дискретные и непрерывные.

Версии происхождения человека. Основные теории происхождения человека

... является таким существом. Благодаря эволюции и стремлению выживать люди стали развивать свои умения и познания. Теория Дарвина о происхождении человека Настоящий переворот в науке вызвала публикация работы ... Ч. Дарвина «Происхождение видов…» (1859 г.). Он утверждал, что ...

Дискретные источники информации

Дискретные источники информации генерируют сообщения посредством серии фиксированных значений. Ключевой особенностью таких источников является наличие ограниченного количества возможных состояний. Например, цифровая информация на компьютере представляет собой строки бинарного кода — единицы и нули, которые иллюстрируют дискретное сообщение.

Непрерывные источники информации

Напротив, непрерывные источники информации генерируют сообщения при помощи процессов, которые могут принимать бесконечное исполнение статусов. Они предлагают неограниченное число возможных состояний за определенный интервал времени. Примером такого рода источников является человеческая речь, которая может изменяться в течение времени, с бесконечной вариацией тонов и интонаций.

Аналоговые и цифровые сигналы

В контексте передачи информации, также важно отметить разницу между аналоговыми и цифровыми сигналами. Аналоговый сигнал представляет собой сигнал, параметр которого может принимать бесконечное количество значений, в то время как цифровой сигнал принимает определенное число дискретных значений, как правило, два: 0 и 1.

Применимость одного типа сигнала по сравнению с другим зависит от контекста и от применения, при этом каждый тип сигнала обладает своими существенными преимуществами и ограничениями.

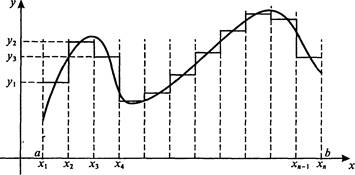

Непрерывное сообщение может быть представлено непрерывной функцией, заданной на некотором отрезке [а, Ь] (см. рис. 2).

Непрерывное сообщение можно преобразовать в дискретное (такая процедура называется дискретизацией).

Для этого из бесконечного множества значений этой функции (параметра сигнала) выбирается их определенное число, которое приближенно может характеризовать остальные значения. Один из способов такого выбора состоит в следующем. Область определения функции разбивается точками x 1 , x 2 ,… хn , на отрезки равной длины и на каждом из этих отрезков значение функции принимается постоянным и равным, например, среднему значению на этом отрезке; полученная на этом этапе функция называется в математике ступенчатой. Следующий шаг – проецирование значений “ступенек” на ось значений функции (ось ординат).

Полученная таким образом последовательность значений функции у 1 , у 2 , … уn . является дискретным представлением непрерывной функции, точность которого можно неограниченно улучшать путем уменьшения длин отрезков разбиения области значений аргумента.

Рис. 1. Процедура дискретизации непрерывного сообщения

Ось значений функции можно разбить на отрезки с заданным шагом и отобразить каждый из выделенных отрезков из области определения функции в соответствующий отрезок из множества значений (рис. 2).

В итоге получим конечное множество чисел, определяемых, например, по середине или одной из границ таких отрезков.

Таким образом, любое сообщение может быть представлено как дискретное, иначе говоря последовательностью знаков некоторого алфавита.

Криптографические методы защиты информации

... защите информации. Среди всего спектра методов защиты данных от нежелательного доступа особое место занимают криптографические методы. В отличие от других методов, ... количество всех возможных ключей; среднее время, необходимое для криптоанализа. Преобразование T k определяется соответствующим алгоритмом и значением параметра k. Эффективность шифрования с целью защиты информации ... такая функция — ...

Введение

Дискретизация непрерывного сигнала — важная возможность для его обработки на компьютере. В то время как компьютеры являются цифровыми машинами, аналоговые ЭВМ почти не используются в настоящее время. Задача измерения количества информации является сложной и имеет разные подходы. В статье рассматриваются два основных подхода: вероятностный подход Клода Шеннона и объемный подход, который связан с разработкой ЭВМ. В данной статье будет рассматриваться вероятностный подход.

Вероятностный подход

Для примера рассмотрим бросание правильной игральной кости с N гранями. Вероятность выпадения данной грани будет равна 1/N. Выпадение грани может быть представлено в виде численной величины H, которая измеряет неопределенность данного события.

Таким образом, энтропия (H) будет равна:

H = log2 N

Функция увеличивается по N и неотрицательная.

Давайте рассмотрим конкретный пример с костью, имеющей 6 граней:

- Количество информации о выпадении 1: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

- Количество информации о выпадении 2: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

- Количество информации о выпадении 3: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

- Количество информации о выпадении 4: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

- Количество информации о выпадении 5: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

- Количество информации о выпадении 6: I = H1 — H2 = log2 6 — log2 1 = 2.58 бит

Как видно из примера, количество информации, связанное с выпадением каждой грани, одинаково и составляет 2.58 бит, что является не только количественной мерой информации, но и ее качественным атрибутом.

Следующим важным моментом является определение вида функции f в формуле (1.1).

Если варьировать число граней N и число бросаний кости (обозначим эту величину через М), общее число исходов (векторов длины М, состоящих из знаков 1,2,…. N) будет равно N в степени М:

X=N M . (1.3)

Так, в случае двух бросаний кости с шестью гранями имеем: Х =62 =36. Фактически каждый исход Х есть некоторая пара (X1 , X2 ), где X1 и X2 – соответственно исходы первого и второго бросаний (общее число таких пар – X).

Ситуацию с бросанием М раз кости можно рассматривать как некую сложную систему, состоящую из независимых друг от друга подсистем – “однократных бросаний кости”. Энтропия такой системы в М раз больше, чем энтропия одной системы (так называемый “принцип аддитивности энтропии”):

f(6 M ) = M ∙ f(6)

Данную формулу можно распространить и на случай любого N:

F(NM) = M ∙ f(N) (1.4)

Прологарифмируем левую и правую части формулы (1.3):

ln X=M ∙ lnN ,М =lnX/ 1nM .

Автоматизированная система обработки информации и управления (АСОИУ)

... перед субъектами рынка в сфере коммерческого и технического учета. Автоматизированная система обработки информации и управления (АСОИУ) Основа электроэнергетики - объединенная энергетическая система, которая осуществляет технологический процесс производства электроэнергии, транспорта и ...

Подставляем полученное для M значение в формулу (1.4):

![]()

Обозначив через К положительную константу , получим: f(X) =К ∙ lnХ, или, с учетом (1.1), H=K ∙ ln N. Обычно принимают К = 1 / ln 2. Таким образом

H = log 2 N. (1.5)

Это – формула Хартли.

Важным при введение какой-либо величины является вопрос о том, что принимать за единицу ее измерения. Очевидно, Н будет равно единице при N=2. Иначе говоря, в качестве единицы принимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятных исходов (примером такого опыта может служить бросание монеты при котором возможны два исхода: “орел”, “решка”).

Такая единица количества информации называется “бит”.

Все N исходов рассмотренного выше опыта являются равновероятными и поэтому можно считать, что на “долю” каждого исхода приходится одна N-я часть общей неопределенности опыта: (log2 N) 1N. При этом вероятность i -го исхода Рi равняется, очевидно, 1/N.

Таким образом,

![]() (1.6)

(1.6)

Р i

В качестве примера определим количество информации, связанное с появлением каждого символа в сообщениях, записанных на русском языке. Будем считать, что русский алфавит состоит из 33 букв и знака “пробел” для разделения слов. По формуле (1.5)

Н = log2 34 ≈ 5 бит.

Однако, в словах русского языка (равно как и в словах других языков) различные буквы встречаются неодинаково часто. Ниже приведена табл. 1 вероятностей частоты употребления различных знаков русского алфавита, полученная на основе анализа очень больших по объему текстов.

Binary digiTs

Для удобства использования введены и более крупные, чем бит, единицы количества информации. Так, двоичное слово из восьми знаков содержит один, байт информации, 1024 байта образуют килобайт (кбайт), 1024 килобайта – мегабайт (Мбайт), а 1024 мегабайта – гигабайт (Гбайт).

Между вероятностным и объемным количеством информации соотношение неоднозначное. Далеко не всякий текст, записанный двоичными символами, допускает измерение объема информации в кибернетическом смысле, но заведомо допускает его в объемном. Далее, если некоторое сообщение допускает измеримость количества информации в обоих смыслах, то они не обязательно совпадают, при этом кибернетическое количество информации не может быть больше объемного.

В дальнейшем практически всегда количество информации понимается в объемном смысле.

4. Информация: более широкий взгляд

Подробнее>>

5. Свойства информации

Свойства информации:

Запоминаемость информации

Это свойство скорее всего является наиболее важным из всех, так как именно оно позволяет нам воспринимать, сохранять и вспоминать информацию, с которой мы взаимодействуем каждый день. Без возможности запоминания, обмен информацией был бы крайне затруднён. При этом под «макроскопической» информацией мы понимаем ту информацию, которую мы можем запомнить и сохранить в нашей памяти в пределах определенного времени или пространства.

Кодирование информации

... имеет специальное название - кодирование информации. Цель реферата: изучение теоретических аспектов применения систем кодирования информации. Задачи реферата: Узнать и изучить все способы кодирование информации; Выявить различные формы представления информации; Сделать выводы В данном реферате использована литература прошлых ...

Передаваемость информации

Теория информации К. Шеннона отлично описывает передачу информации между различными системами. Однако, в данном контексте рассматривается несколько другой аспект — способность информации быть копированной. Если информация может быть «запомнена» другой макроскопической системой и при этом остаться идентичной самой себе, подобное свойство может быть названо передаваемостью.

Воспроизводимость информации

Это свойство также связано с передаваемостью информации, но не является её независимым базовым свойством. Важно понимать что, несмотря на физическое перемещение информации в пространстве, её эффективное количество и её качество сохраняются.

Преобразуемость информации

Информация всегда может менять форму и способ своего существования, благодаря своему свойству преобразуемости. Оно позволяет не только копировать информацию, но и преобразовывать ее в новую форму, часто увлекательную и обогащающую наш опыт восприятия информации.

Стираемость информации

Под стираемостью понимается способ изменения информации, при котором её количество уменьшается до нуля. Данное свойство тесно связано с преобразуемостью информации и является важным аспектом эффективного обработки и управления информацией на макроскопическом уровне.

Представление информации происходит в различных формах в процессе восприятия окружающей среды живыми организмами и человеком, в процессах обмена информацией между человеком и человеком, человеком и компьютером, компьютером и компьютером и так далее. Преобразование информации из одной формы представления (знаковой системы) в другую называется кодированием.

Средством кодирования служит таблица соответствия знаковых систем, которая устанавливает взаимно однозначное соответствие между знаками или группами знаков двух различных знаковых систем.

1.2 Кодирование информации

Подводя итог сказанному, отметим, что предпринимаются (но отнюдь не завершены) попытки ученых, представляющих самые разные области знания, построить единую теорию, которая призвана формализовать понятие информации и информационного процесса, описать превращения информации в процессах самой разной природы. Движение информации есть сущность процессов управления, которые суть проявление имманентной активности материи, ее способности к самодвижению. С момента возникновения кибернетики управление рассматривается применительно ко всем формам движения материи, а не только к высшим (биологической и социальной).

Многие проявления движения в неживых – искусственных (технических) и естественных (природных) – системах также обладают общими признаками управления, хотя их исследуют в химии, физике, механике в энергетической, а не в информационной системе представлений. Информационные аспекты в таких системах составляют предмет новой междисциплинарной науки – синергетики.

Высшей формой информации, проявляющейся в управлении в социальных системах, являются знания. Это наддисциплинарное понятие, широко используемое в педагогике и исследованиях по искусственному интеллекту, также претендует на роль важнейшей философской категории. В философском плане познание следует рассматривать как один из функциональных аспектов управления. Такой подход открывает путь к системному пониманию генезиса процессов познания, его основ и перспектив.

Представление данных в памяти персонального компьютера (числа, ...

... хранения в компьютере. Для этого достаточно перевести число в двоичную систему счисления. Однако стоит отметить, что кодирование отрицательных целых чисел имеет свои особенности, которые мы рассмотрим в контексте представления числовой информации. Вещественные числа В отличие ...

В процессе обмена информацией часто возникает необходимость кодирования и декодирования данных. При вводе символа алфавита на компьютере с помощью клавиатуры происходит кодирование этого символа — преобразование его в компьютерный код. При выводе символа на экран монитора или принтера происходит обратный процесс — декодирование, когда компьютерный код преобразуется в графическое изображение символа.

С появлением языка и знаковых систем возросли возможности общения между людьми. Идеи, знания и данные стали сохраняться и передаваться на расстояние и в другие времена не только своим современникам, но и будущим поколениям. Важные моменты и деяния людей были увековечены в памятниках и надписях, которые до сих пор остаются интересом для ученых. Нализные рисунки, такие как петроглифы, представляют собой непостижимую загадку для нас. Возможно, через такой способ древние люди хотели вступить в контакт с нами, будущими поколениями, и сообщить нам о событиях их времени.

Каждый народ имеет свой язык, который состоит из набора символов или букв. Мы уже знакомы с языками математики, физики и химии.

Понятие кодирования часто используется для обозначения представления информации с помощью определенного языка.

Код — это набор символов или условных обозначений, используемых для представления информации. Кодирование — это процесс представления информации в виде кода.

Водители передают сигналы другим участникам дорожного движения с помощью гудков или миганием фар. Кодирование здесь осуществляется через наличие или отсутствие гудка, а в случае с фарами — через их мигание или погасание.

Мы также сталкиваемся с кодированием информации при переходе дороги по сигналам светофора. Код определяется цветами светофора: красный, желтый, зеленый.

Естественный язык, используемый людьми для общения, также основан на коде. Однако он называется алфавитом. При разговоре мы передаем этот код с помощью звуков, а при письме — с помощью букв. Одна и та же информация может быть представлена с помощью разных кодов. Например, разговор можно записать с использованием русских букв или специальных стенографических символов.

1.3 Представление информации в двоичном коде

В процессе развития техники человечество стало искать различные способы передачи информации. Одним из значимых открытий в этой области стал код, изобретенный американским изобретателем Сэмюэлем Морзе во второй половине XIX века. До сих пор этот код имеет широкое применение и основан на использовании трех символов: тире (длинный сигнал), точка (короткий сигнал) и пауза (отсутствие сигнала).

Однако для более эффективной передачи информации требуется договоренность между отправителем и получателем о заранее установленных символах и их значениях. Эту проблему помог решить Готфрид Вильгельм Лейбниц, немецкий ученый XVII века. Он предложил уникальную систему представления чисел, основанную на использовании только двух символов: 0 и 1. Этот метод представления информации стал известен как двоичный код.

Форматы данных, представление и кодирование информации в компьютере

... обусловило и развитие способов представления и кодирования различных видов информации в компьютере. 1.2 Представление данных в компьютере Для эффективной обработки данных в компьютере необходимо выбрать соответствующий формат и способ их представления. Существует множество форматов данных, каждый из которых ...

Двоичный код, состоящий из двух символов 0 и 1, широко используется в современных технических устройствах, включая компьютеры. Это специальный язык, позволяющий представить любую информацию с помощью комбинации двух цифр. Отсюда происходит термин «двоичные цифры» или «биты» (BinaryDigits — двоичные знаки).

Важно отметить, что компьютеры обрабатывают информацию исключительно в двоичном коде, используя две цифры 0 и 1. Поэтому в компьютерной науке очень важными процессами являются кодирование и декодирование. Кодирование — это преобразование входной информации в двоичный код, понятный компьютеру. Декодирование — противоположный процесс, в результате которого данные из двоичного кода преобразуются в понятную человеку форму.

Двоичная система счисления является отражением того, как действительно работают компьютеры на физическом уровне. В компьютерах все данные и операции основаны на двоичных состояниях. Сигнал присутствует или не присутствует. Питание включено или выключено. Физическое свойство или состояние возбуждено или нет. Благодаря двоичной системе счисления, нам легко управлять этими физическими состояниями и данные можно легко передавать и преобразовывать.

Двоичные числа для кодирования информации

Информация в компьютерах представлена в виде двоичных чисел. Все данные, будь то числа, буквы, символы или даже сложные данные, такие как видео и изображения, представлены в виде двоичного кода, при этом каждая шестнадцатеричная цифра представляет собой четыре двоичные цифры. Каждый байт, или восемь бит, может представлять собой число, символ или другой тип данных.

Основная причина выбора двоичной системы счисления для кодирования в компьютерах заключается в простоте управления электронными замками — включено (1) или выключено (0).

В любом цифровом устройстве на базе полевого транзистора именно так и работает передача данных.

Кодирование звука и изображений

Звук и изображения также кодируются с использованием двоичной системы счисления. Звук кодируется в цифровой форме с использованием метода, называемого дискретизацией, или выборочным отводом. В этом процессе амплитуда звукового сигнала измеряется в определенные моменты времени, и эти величины записываются с помощью двоичного кода.

Изображения кодируются пикселями. Каждый пиксель представляет цвет и обычно кодируется компьютером двенадцатью, шестнадцатью, двадцатью четырьмя или тридцатью двумя битами. Это означает, что любой цвет может быть представлен числом от 0 до ~10 миллионов.

Таким образом, компьютеры используют двоичную систему счисления для своей основной функции — обработки и хранения информации. Для этого необходимы только два физически устойчивых состояния, которые можно надежно и быстро контролировать, чтобы процесс работы был стабильным, эффективным и простым для понимания.

Раздел 1: RGB-модель цвета в компьютерной графике

RGB-модель цвета удобна для графического дизайна и компьютерной графики, поскольку каждый цвет может быть сгенерирован простым смешением трех базовых цветов. Этот процесс подчеркивает важность числового представления информации в информатике, поскольку каждый оттенок в RGB-модели представлен числовым кодом.

Понятие информации, данных, информационных ресурсов и знаний

... приводимые далее определения всего лишь поясняют и уточняют эти категории. 1.Основные понятия данных, ресурсов, информации, знаний К базовым понятиям, которые используются в экономической информатике, относятся: данные, информация и знания. Эти понятия часто используются как ...

Раздел 2: Классификация информации

Объективная и субъективная информация обрабатываются различными системами знаний. Как в философии, так и в информатике, роль индивидуального восприятия нельзя недооценивать. Так основной целью в информатике при переводе аналоговой информации в цифровую является сохраниение и передача смысла и значения первоначального оттенка или звука.

Раздел 3: Аналоговая и Цифровая информация

Точное и надежное обрабатывание информации является ключевым для всех аспектов информатики, будь то передача данных, хранение информации или создание графики. Чтобы превратить аналоговую информацию в цифровую, необходимо создавать её числовые представления, то есть кодирование информации.

Раздел 4: Кодирование информации

Кодирование является процессом преобразования аналоговой информации в цифровую с помощью её числового представления. Это может позволить более производительной и точной обработке информации, и, что важнее, более емкому хранению информации.

Раздел 5: Например, Преобразование звука для обработки на компьютере

Примером преобразования аналоговой информации в цифровую может служить реализация звуков. С помощью измерения интенсивности звука на определенных частотах в короткие промежутки времени компьютер может преобразовывать эти данные в числовую форму для дальнейшей обработки, благодаря чему органы чувств человека способны воспринимать эти данные.

Список использованной литературы

- Агальцов В.П., Титов В.М. Информатика для экономистов: Учебник. – М.: ИД «ФОРУМ»: ИНФРА-М, 2006. – 448 с.

- Информатика для экономистов: Учебник / Под общ. ред. В.М. Матюшка. – М.: ИНФРА-М, 2007. – 880с.

- Информатика. Общий курс: Учебник / Под ред. В.И. Колесникова. – М.: Издательско-торговая корпорация «Дашков и К ◦ »; Ростов н/Д: Наука-Пресс, 2008. – 400 с.

- Информатика: Практикум по технологии работы на компьютере / Под ред. Н.В. Макаровой. – М.: Финансы и статистика, 2005. – 256 с.

- Информатика: Учебник / Под общ. ред. А.Н. Данчула. – М.: Изд-во РАГС, 2004. – 528 с.

- Соболь Б.В. Информатика: Учебник / Соболь Б.В., Галин А.Б., Панов Ю.В., Рашидова Е.В., Садовой Н.Н. – М.: Ростов н/Д: Феникс, 2005. – 448 с.